martes, 30 de junio de 2015

Ingeniería Automotriz

http://informaticaplicadaaeog.wikispaces.com/Netgraf%C3%ADa+Ingenieria+Automotriz

Ascensor Espacial

Un ascensor espacial es un ascensor hipotético que conecta la superficie de un planeta con el espacio.

Básicamente es una estación espacial en una órbita geosíncrona, y de la que parte un cable de 35.786 km de largo que llega hasta el suelo, y que puede tener forma de riel. Para mantener el equilibrio de la estructura, además de situar el anclaje en algún punto lo más cerca posible del ecuador, para minimizar los efectos de tensión por la diferencia entre la rotación de la Tierra y la órbita geosincrónica del satélite, los ponentes de esta tecnología futurista proponen utilizar un tramo de cable idéntico extendido hacia el espacio o bien un contrapeso, de tal suerte que el cable estaría en equilibrio con su centro de masas en órbita geosíncrona. Una vez el cable en su lugar, pueden subir y bajar por él naves y cargas a un coste unas cien veces menor que el que supone lanzarlas por medio de un cohete1 (prácticamente, el coste de la electricidad necesaria para impulsar el ascensor).

Hipótesis de ascensores espaciales

Cable de nanotubos

Los ascensores espaciales eran hasta hace muy poco un tema exclusivo del género de la ciencia ficción, pues ningún material conocido podía soportar la enorme tensión producida por su propio peso. Actualmente ciertos materiales comienzan a parecer viables como materia prima: los expertos en nuevos materiales consideran que teóricamente los nanotubos de carbono pueden soportar la tensión presente en un ascensor espacial. Debido a este avance en la resistencia de los nuevos materiales, varias agencias están estudiando la viabilidad de un futuro ascensor espacial:

En Estados Unidos, un antiguo ingeniero de la NASA llamado Bradley C. Edwards ha elaborado un proyecto preliminar que también están estudiando científicos de la NASA. Edwards afirma que ya existe la tecnología necesaria, que se necesitarían 20 años para construirlo y que su costo sería 10 veces menor que el de la Estación Espacial Internacional. El ascensor espacial de Edwards no se parece a los presentes en las obras de ficción, al ser mucho más modesto y a la vez innovador en lo que concierne a su eventual método de construcción.

Edwards propone que el ascensor espacial se construya de manera análoga a como se construían los puentes en tiempos pasados: tendiendo una cuerda entre ambos extremos del obstáculo natural, y reforzar progresivamente la cuerda inicial con tramos cada vez más gruesos y resistentes. El elevador de Edwards sería una cinta extremadamente fina (unos cuantos nanómetros) de nanotubos de carbono, que sería lanzada al espacio de manera convencional. Una vez en órbita geosíncrona, la cinta sería descendida a la Tierra con la ayuda de un peso. La cinta sería tan ligera que la nave en la que fue

lanzada serviría de contrapeso.

LaserMotive LLC

En noviembre de 2009 un proyecto desarrollado en Seattle en los Estados Unidos ganó un concurso apoyado por la NASA que tenía como objetivo diseñar un ascensor espacial basado en las ideas presentadas en la literatura científica y de ficción. La máquina ganadora, llamada "LaserMotive LLC" logró ascender 899 metros a lo largo de un cable que colgaba desde un helicóptero e impulsada por un motor eléctrico el cual recibía su carga a partir de un conjunto de celdas voltaicas que convertían en energía eléctrica la luz emitida por un láser en tierra que apuntaba directamente a la máquina.

Esta máquina consiguió mediante este método ascender los 899 metros de cable en tres minutos y 48 segundos por lo cual se le entregó un premio de 900.000 dólares por parte del Proyecto Retos Centenarios de la NASA.

lunes, 8 de junio de 2015

Fotografía digital

La fotografía digital consiste en la obtención de imágenes mediante una cámara oscura, de forma similar a la Fotografía química. Sin embargo, así como en esta última las imágenes quedan grabadas sobre una película fotosensible y se revelan posteriormente mediante un proceso químico, en la fotografía digital las imágenes son capturadas por un sensor electrónico que dispone de múltiples unidades fotosensibles, las cuales aprovechan el efecto fotoeléctrico para convertir la luz en una señal eléctrica, la cual es digitalizada y almacenada en una memoria.

Ventajas

Ventajas

La ventaja de este sistema respecto a la fotografía química es que permite disponer de las imágenes grabadas al instante, sin necesidad de llevar la película al laboratorio y revelar los negativos para poder ver las imágenes; esta ventaja en la rapidez en la disponibilidad de la imagen permite que el fotógrafo haga los cambios en el momento y realice las correcciones que considere pertinentes de forma inmediata, facilitando así lograr la imagen que se desea. En la cámara digital pueden verse en una pantalla las fotos que se acaban de tomar. La cámara se puede conectar a una computadora u otro dispositivo capaz de mostrar las fotos en un monitor. Como están en un formato digital, las fotos pueden enviarse directamente por correo electrónico, publicarse en la Web y se pueden procesar con programas de tratamiento fotográfico en una computadora, para ampliarlas o reducirlas, realizar un reencuadre (una parte de la foto), rectificar los colores y el brillo, y realizar otras muchas posibles modificaciones según el programa que se utilice.

Otra gran ventaja de la fotografía digital es que cada vez que la cámara toma una foto crea un archivo de metadatos Exif (datos no visuales) y guarda dentro del archivo de imagen información relevante de la captura como la fecha, la hora, la apertura del diafragma, la velocidad de obturación, velocidad del ISO. Esta información es muy útil para estudiar las imágenes y entender más acerca de cada fotografía y también facilita el ordenamiento y el manejo de los archivos fotográficos.

Otros recursos útiles existentes en fotografía digital son el histograma de brillo, que es un gráfico que muestra la distribución de los píxeles de la imagen según sus niveles de brillo; así como el histograma RGB que muestra la distribución de los píxeles en los diferentes canales de color: en el caso del modo RGB, serán los canales de rojo (R:red), Verde (G:green), y Azul (B:blue). Este recurso no existe en fotografía química.

Desventajas

ResoluciónLa resolución de una película de 35 mm es alrededor de 320 píxeles por milímetro, siendo aproximadamente de 87 Megapíxeles. En cambio expertos fotógrafos dicen que una buena cámara de película química, con un objetivo de alta resolución, una película de alta calidad y un buen revelado equivaldría a unos 40 Megapíxeles. Sin embargo, en la mayoría de los casos, las fotografías en película de 35mm -en especial con película de bajo costo- no sobrepasan los 6 millones de puntos, debido al tipo de cámara e inexperiencia de la persona que está fotografiando. En cambio, con una cámara digital de relativa calidad y una persona inexperta, se pueden obtener imágenes de mejor resolución que con su contra parte química. Hoy en día (año 2011) algunas cámaras digitales han alcanzado los 45 Megapíxeles en el formato 35mm, como es el caso de la cámara Sigma SD1.

Las cámaras digitales con sensor "full frame" presentan una figura de ruido mejor que la película química, especialmente en sensibilidades ISO bajas. Por otra parte, y como una visión un tanto más subjetiva, algunos fotógrafos consideran que el grano de la película de 35mm es más agradable a la vista que el ruido de la cámara digital; el grano es siempre -o casi siempre- monocromático, mientras que el ruido se expresa en puntos de colores, que interrumpen la uniformidad de la imagen.

Debido al calentamiento del dispositivo electrónico por el flujo continuo de corriente, el sensor agrega ruido a las imágenes cuando estas se obtienen mediante una exposición prolongada; en sistemas profesionales, esto se corrige generalmente utilizando una celda Peltier, que mantiene el dispositivo a una temperatura baja, evitando de esta manera la aparición de ruido térmico, y en algunos casos (fotografía astronómica) es frecuente el uso de líquidos a muy baja temperatura para la refrigeración del sensor (nitrógeno e hidrógeno líquidos); otra forma que existe de reducir el ruido es lo que se conoce como apilado de exposición o "exposure stacking", que superpone varias imágenes tom

adas durante el tiempo general de la captura para restar el patrón de ruido de la imagen final.

domingo, 7 de junio de 2015

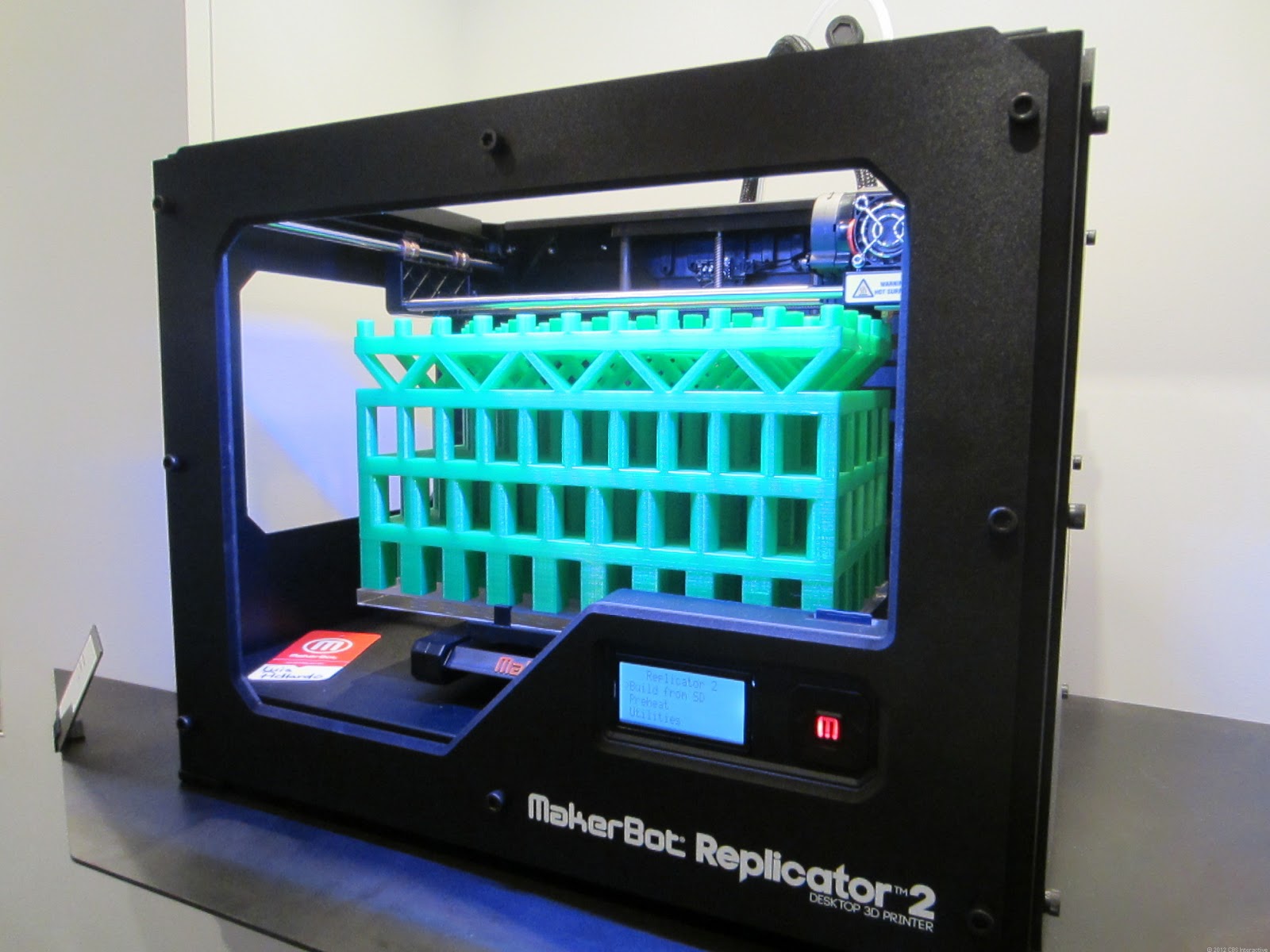

Impresoras 3D

Una impresora 3D es una máquina capaz de realizar "impresiones" de diseños en 3D, creando piezas o maquetas volumétricas a partir de un diseño hecho por ordenador. Surgen con la idea de convertir archivos de 2D en prototipos reales o 3D. Comúnmente se ha utilizado en lamatricería o la prefabricación de piezas o componentes, en sectores como la arquitectura y el diseño industrial. En la actualidad se está extendiendo su uso en la fabricación de prótesis médicas, ya que la impresión 3D permite adaptar cada pieza fabricada a las características exactas de cada paciente.

Las impresoras 3D normalmente utilizan diversos polímeros como material de impresión, pero además existen clases especiales de impresoras tales como Foodini, impresora que crea comida, o algunas que hasta pueden imprimir casas depositando cemento por capas pero la mayoría de los modelos comerciales actualmente son de dos tipos:

de compactación, con una masa de polvo que se compacta por estratos.

de adición, o de inyección de polímeros, en las que el propio material se añade por capas.

Según el método empleado para la compactación del polvo, se pueden clasificar en:

Impresoras 3D de tinta: utilizan una tinta aglomerante para compactar el polvo. El uso de una tinta permite la impresión en diferentes colores.

Impresoras 3D láser: un láser transfiere energía al polvo haciendo que se polimerice. Después se sumerge en un líquido que hace que las zonas polimerizadas se solidifiquen.

Una vez impresas todas las capas sólo hay que sacar la pieza. Con ayuda de un aspirador se retira el polvo sobrante, que se reutilizará en futuras impresiones.

Funcionamiento

Software

Para poder realizar el diseño de piezas que se desee imprimir en 3D se requiere de algún software CAD (diseño asistido por computadora), de los cuales podemos citar:

Blender

Catia

FreeCAD

OpenSCAD

SolidWorks

Tinkercad

Entre otros.

Muchos de estos programas son muy sencillos de utilizar, ya que las interfaces son muy agradables para el usuario, además algunos de estos nos presentan herramientas especiales para poder saber si nuestro diseño cumple con las características esperadas tanto en forma como rendimiento.

http://es.wikipedia.org/wiki/Impresora_3D

domingo, 24 de mayo de 2015

Nanotecnología

La nanotecnología es la manipulación de la materia a escala atómica, molecular y supramolecular. La más temprana y difundida descripción de la nanotecnología se refiere a la meta tecnológica particular de manipular en forma precisa los átomos y moléculas para la fabricación de productos a macroescala, ahora también referida como nanotecnología molecular. Subsecuentemente una descripción más generalizada de la nanotecnología fue establecida por la Iniciativa Nanotecnológica Nacional, la que define la nanotecnología como la manipulación de la materia con al menos una dimensión del tamaño de entre 1 a 100 nanómetros. Esta definición refleja el hecho de que los efectos mecánica cuántica son importantes a esta escala del dominio cuántico y, así, la definición cambió desde una meta tecnológica particular a una categoría de investigación incluyendo todos los tipos de investigación y tecnologías que tienen que ver con las propiedades especiales de la materia que ocurren bajo cierto umbral de tamaño. Es común el uso de la forma plural de "nanotecnologías" así como "tecnologías de nanoescala" para referirse al amplio rango de investigaciones y aplicaciones cuyo tema en común es su tamaño. Debido a la variedad de potenciales aplicaciones (incluyendo aplicaciones industriales y militares), los gobiernos han inveritdo miles de millones de dólares en investigación de la nanotecnología. A través de su Iniciativa Nanotecnológica Nacional, Estados Unidos ha invertido 3,7 mil millones de dólares. La Unión Europea ha invertido 1,2 mil millones yJapón 750 millones de dólares.

Nano es un prefijo griego que indica una medida (10-9 = 0,000 000 001), no un objeto; de manera que la nanotecnología se caracteriza por ser un campo esencialmente multidisciplinar, y cohesionado exclusivamente por la escala de la materia con la que trabaja.

La nanotecnología definida por el tamaño es naturalmente un campo muy amplio, que incluye diferentes disciplinas de la ciencia tan diversas como la ciencia de superficies, química orgánica, biología molecular, física de los semiconductores, microfabricación, etc. Las investigaciones y aplicaciones asociaas son igualmente diversas, yendo desde extensiones de lafísica de los dispositivos a nuevas aproximaciones completamente nuevas basadas en el autoensamblaje molecular, desde el desarrollo de nuevos materiales con dimensiones en la nanoescalas a el control directo de la materia a escala atómica.

Actualmente los científicos están debatiendo el futuro de las implicaciones de la nanotecnología. La nanotecnología puede ser capaz de crear nuevos materiales y dispositivos con un vasto alcance de aplicaciones, tales como en la medicina, electrónica, biomateriales y la producción de energía. Por otra parte, la nanotecnología hace surgir las mismas preocupaciones que cualquier nueva tecnología, incluyendo preocupaciones acerca de la toxicidad y el impacto ambiental de los nanomateriales, y sus potenciales efectos en la economía global, así como especulaciones acerca de varios escenarios apocalípticos. Estas preocupaciones han llevado al debate entre varios grupos de defensa y gobiernos sobre si se requieren regulaciones especiales para la nanotecnología.

http://es.wikipedia.org/wiki/Nanotecnolog%C3%ADa

COLAPSO DE INTERNET

El colapso de Internet llegará en el año 2023

Acostumbramos a asociar la Red con lo virtual. Pero es muy real. Internet funciona gracias a un entramado de cables, ylos cables tienen una capacidad finita. Por otro lado,transmitir información consume energía, un consumo mayor como más datos y a más velocidad se envíen.

Según Andrew Ellis, profesor de Comunicaciones Ópticas en la Universidad de Aston, la conexión a Internet de los británicos ya consume entre el 8 y el 15% de la energía del Reino Unido, equivalente a la producción de tres centrales nucleares. Pero este consumo se dobla cada cuatro años. A este ritmo, en el año 2035 Internet requerirá toda la energía que produce el Reino Unido, algo completamente inasumible.

"No podemos producir más energía extra, así que la única solución es restringir el acceso", asegura el profesor Ellis.

Su solución pasa por racionar el consumo de Internet, asignando un límite de datos mensual a cada conexión, o cobrar por el exceso de consumo, en cuyo caso Internet podría convertirse en un privilegio de las personas con mayor capacidad adquisitiva. De los ricos, vaya...

Pero existe otra alarma aún más acuciante. Los cables de fibra óptica por los que circula la información hasta las casas y las empresas están comenzando a llenarse. Cada vez se requieren más datos a más velocidad, y esos valores tienen un límite. Según Andrew Lord, experto de la operadora BT, los cables de fibra óptica alcanzarán su máxima capacidad en el año 2023. A partir de entonces, para mantener la demanda abría que añadir más cables adicionales a cada conexión, pero eso obligaría a modificar toda la infraestructura de Internet, y los usuarios tendría que pagar el coste extra de usar más de un cable, lo que conllevaría un aumento en las tarifas de Internet de al menos el 25 o el 30%. Por si fuera poco, el consumo de energía se duplicaría, acelerando el colapso energético del que hablábamos al principio de la noticia.

El problema es tan real que esta misma semana se ha convocado una reunión en la Royal Society británica, en donde expertos en telecomunicaciones buscarán soluciones para afrontar este inminente colapso de Internet.

Lo cierto es que no hace falta ser un experto para darse cuenta de que algo no cuadra en nuestro consumo de Internet. Las empresas y los negocios se trasladan a la Red, pero ésta tiene una capacidad finita. Las fotos y los vídeos han aumentando en tamaño y cantidad, gracias a los smartphones con resolución HD y los servicios de streaming. Una película o un juego ocupaban unos pocos megas hace unos años. Ahora ocupan docenas de gigas. Y mientras, el número de usuarios y los usos de Internet crecen año tras año. Todas estas cifras se duplican cada poco tiempo.

La amenaza es real, aunque los expertos no se ponen de acuerdo a la hora de decidir si el colapso ocurrirá dentro de veinte años, o de cincuenta.

Continuamente se trabaja en nuevas tecnologías para aumentar el caudal de Internet, y reducir el consumo energético. ¿Serán suficientes para evitar el colapso de Internet?

http://computerhoy.com/noticias/internet/colapso-internet-llegara-ano-2023-27991

Posible Cura para el Sida

Un grupo de investigadores de la Escuela de Medicina de la Universidad de Washington ha demostrado que elveneno de abeja es capaz de matar el VIH. En el nuevo estudio hallaron que una toxina llamada melitina, encontrada en el veneno de las abejas, puede destruir el virus, dejando células circundantes ilesas.

El estudio, que aparece publicado en la edición Antiviral Therapy, explica que el veneno de abeja contiene una potente toxina llamada melitina que puede hacer unos agujeros en la envoltura protectora que rodea al VIH, así lo publica The Huffington Post.

Además de acabar con el virus, los científicos descubrieron que la melitina cargada en nanopartículas también puede ser eficaz a la hora de atacar células tumorales.

En su investigación, los científicos añadieron una protección sobre la superficie de las nanopartículas, que cuando estas entran en contacto con las células normales, las partículas simplemente rebotan. Pero cuando encuentran el virus destruyen su capa protectora y lo eliminan.

Por el contrario, aunque la mayoría de los medicamentos contra el VIH inhiben la capacidad del virus para replicarse, no hacen nada para detener la infección inicial, por lo que algunas cepas del virus acaban encontrando formas de evitar estos medicamentos y reproducirse de todos modos.

Este hallazgo puede ayudar al desarrollo de un gel vaginal para prevenir la propagación del VIH y un tratamiento vía intravenosa para ayudar a las personas infectadas.

Este estudio viene de la mano con la noticia de que un bebé en Misisipí que había nacido con VIH fue curado. Su madre fue diagnosticada con el virus durante el parto y el bebé recibió un tratamiento de tres fármacos 30 horas después de haber nacido.

http://www.informacionjoven.com/tenco/veneno-de-abeja-mata-el-vih-unam-descubre-cura-contra-sida/

sábado, 9 de mayo de 2015

lunes, 4 de mayo de 2015

DÍA DE LA MADRE

El Día de la Madre o Día de las Madres es una festividad

que se celebra en honor a las madres en todo el mundo, en diferentes

fechas del año según el país. Su origen contemporáneo se remitiría al Mother's Friendship Day y las reuniones Mother's Day Meetings organizadas en 1865 o 1868 por Ann Maria Reeves Jarvis, en que las madres se reunían para intercambiar opiniones sobre distintos temas de actualidad.

El Día de la Madre o Día de las Madres es una festividad

que se celebra en honor a las madres en todo el mundo, en diferentes

fechas del año según el país. Su origen contemporáneo se remitiría al Mother's Friendship Day y las reuniones Mother's Day Meetings organizadas en 1865 o 1868 por Ann Maria Reeves Jarvis, en que las madres se reunían para intercambiar opiniones sobre distintos temas de actualidad.HISTORIA

Las primeras celebraciones del Día de la Madre se remontan a la antigua Grecia, donde se le rendían honores a Rea, la madre de los dioses Zeus, Poseidón y Hades.

Igualmente los romanos llamaron a esta celebración Hilaria cuando la adquirieron de los griegos. Se celebraba el 15 de marzo en el templo de Cibeles y durante tres días se realizaban ofrendas.

Los católicos transformaron estas celebraciones para honrar a la Virgen María, la madre de Jesús. En el santoral católico el 8 de diciembre se celebra la fiesta de la Inmaculada Concepción, fecha que los católicos adoptaron para la celebración del Día de la Madre.

En Inglaterra hacia el siglo XVII,

tenía lugar un acontecimiento similar, también relacionado con la

Virgen, que se denominaba Domingo de las Madres. Los niños concurrían a misa

y regresaban a sus hogares con regalos para sus progenitoras. Además,

como muchas personas trabajaban para gente acaudalada y no tenían la

oportunidad de estar en sus hogares, ese Domingo se le daba el día libre

para visitar a sus familias.

En 1870 la poetisa y activista Julia Ward Howe escribió la Proclama del Día de la Madre,

un apasionado llamado a la paz y al desarme. Durante un par de años,

Ward Howe empeñó sus esfuerzos en llevar a cabo un congreso de esta

naturaleza.

De todos modos, en 1873, mujeres en 18 ciudades estadounidenses realizaron una reunión del Día de la Madre. Boston

lo siguió celebrando durante al menos una década más. Al paso de los

años, se fueron apagando más festejos. Howe continuó trabajando por

otras vías por los derechos de las mujeres y por la paz. El 12 de mayo de 1907 Ana Jervis

dos años después de la muerte de su madre, quiso conmemorar el

fallecimiento y organizó un Día de la Madre para hacerlo. A partir de

entonces encabezó una activa campaña que fue extendiéndose a todo el

territorio de los Estados Unidos.

Finalmente, siete años después el presidente Woodrow Wilson declaró en el año 1914, el Día de la Madre como el segundo domingo de mayo en Estados Unidos.

Así fue gestado el día internacional de la madre que después fue

encontrando eco en otros países que lo adoptaron hasta tenerse la

celebración conocida en la actualidad.

Por su parte, en Argentina y Brasil el Día de la Madre se festeja el tercer domingo de octubre.

domingo, 3 de mayo de 2015

OCULUS RIFT

Oculus Rift es un casco de realidad virtual que está siendo desarrollado por Oculus VR. Durante su periodo como compañía independiente, Oculus VR ha invertido 91 millones de dólares para el desarrollo de Oculus Rift. La versión para el consumidor está prevista para 2015El fundador de Oculus, Palmer Luckey, fue ganando reputación por tener la mayor colección personal de head-mounted display en el mundo. Desde hace muchos años ha estado ejerciendo de moderador en Meant to be Seen 3D (MTBS3D), unos foros de debate sobre 3D. Palmer desarrolló la idea de crear un nuevo head-mounted display que fuera más efectivo que los que están actualmente en el mercado, además de más económicos para los gamers. Casualmente, John Carmack estuvo haciendo su propia investigación al mismo tiempo que Palmer llevaba a cabo su desarrollo. Más tarde, Carmack crearía una versión de muestra que favorecería el prototipo de Luckey. Paralelamente, justo antes de la Electronic Entertainment Expo del 2012, Id Software anunció que su futura actualización deDoom 3, que sería conocida como BFG Edition, sería compatible con las unidades de head-mounted display. Durante la convención, Carmack presentó un head-mounted display sujeto con cinta adhesiva basada en el prototipo del Oculus Rift de Palmer, el cual funcionaba con el software de Carmack. Este tenía una alta velocidad IMU y una pantalla LCD de 5.6 pulgadas ( 14cm ) visible a través de unas lentes duales que estaban posicionadas encima de los ojos. De esta forma, proveía una visión horizontal de 90 grados y una vertical de 110 grados en una perspectiva 3D estereoscópica. El 25 de marzo de 2014, Facebook anunció que había acordado comprar Oculus VR por 400 millones de dólares en efectivo, 1.6 billones en valores de Facebook y unos 300 millones adicionales aOculus VR. Este será utilizado para el cumplimiento de ciertos objetivos financieros en una transacción que se espera que finalice en el segundo trimestre de 2014.

Los juegos y sus plataformas deben ser diseñados específicamente para funcionar correctamente con Oculus Rift. Para ello, Oculus ha creado un kit de desarrollo de software ( SDK ) para ayudar a los desarrolladores con la integración de Oculus Rift en sus juegos. Este incluye código, ejemplos y documentación. La integración de Oculus Rift en los juegos empezará con los PC y Smartphones, seguido más adelante por las consolas. Desde su inicio, muchos desarrolladores han estado trabajando en su integración.21 Algunos títulos pueden ser jugables gracias al código abierto: Vireio Perception VR Drivers.22

Team Fortress 2 fue el primer videojuego donde se añadió soporte para el Oculus Rift, y actualmente está disponible para jugar con el kit de desarrollo de Oculus Rift mediante el uso de una opción en la línea de comandos. El segundo título para apoyar el Oculus Rift fue la versión solo para Oculus del Museum of the Microstar, lanzado en abril de 2013. Half-Life 2 fue el tercero, y Hawken el cuarto. Oculus utilizó este último en la demo del Rift en la GDC.

Otros juegos que cuentan con soporte total o parcial para esta plataforma son: Left 4 Dead, Skyrim, Portal 2, Half Life 2, y Bioshock.

Cabe señalar que muchos de los juegos actuales no se traducen bien a VR debido al uso de características tales como HUD, escenas cinemáticas, menús, secciones en tercera persona, velocidades de movimiento rápido, no ser capaz de ver el propio cuerpo, etc.

El primer videojuego español nativo para Oculus Rift fue Atfens VR creado desde 0 para esta plataforma de la mano de un equipo de desarrollo catalán.

http://es.wikipedia.org/wiki/Oculus_Rift

domingo, 19 de abril de 2015

HOLOGRAMAS

La holografía es una técnica avanzada de fotografía que consiste en crear imágenes tridimensionales basada en el empleo de la luz. Para esto se utiliza un rayo láser que graba microscópicamente una película fotosensible. Ésta, al recibir la luz desde la perspectiva adecuada, proyecta una imagen en tres dimensiones.

La holografía fue inventada en el año 1947 por el físico húngaro Dennis Gabor, que recibió por esto el Premio Nobel de Física en 1971. Recibió la patente GB685286 por su invención. Sin embargo, se perfeccionó años más tarde con el desarrollo del láser, pues los hologramas de Gabor eran muy primitivos a causa de las fuentes de luz tan pobres que se utilizaban en sus tiempos.

Originalmente, Gabor sólo quería encontrar una manera para mejorar la resolución y definición de las imágenes del microscopio electrónico. Llamó a este proceso «holografía», del griego «holos», «completo», ya que los hologramas mostraban un objeto completamente y no sólo una perspectiva.

Los primeros hologramas que verdaderamente representaban un objeto tridimensional bien definido fueron hechos por Emmett Leith y Juris Upatnieks en Estados Unidos, en 1963, y por Yuri Denisyuk en la Unión Soviética. Uno de los avances más prometedores hechos recientemente ha sido su uso para los reproductores de DVD y otras aplicaciones. También se utiliza actualmente tarjetas de crédito, billetes, etiquetas de seguridad, embalajes, certificados, pasaportes y documentos de identidad, así como discos compactos y otros productos, además de su uso como símbolo de originalidad y seguridad.

Principio de funcionamiento de un holograma

Grabado de un holograma

En la imagen de la derecha se alumbra la escena con ondas planas que vienen de la izquierda. Una parte de la luz se refleja en el punto, representado como un círculo blanco. Sólo está representada la luz reflejada hacia la derecha. Esas ondas esféricas se alejan del punto y se adicionan a las ondas planas que alumbran la escena. En los sitios donde las crestas coinciden con crestas y los valles con valles habrá máximos de amplitud. Simétricamente, donde las crestas coinciden con valles y los valles con crestas la amplitud será mínima. Hay sitios del espacio donde siempre la amplitud es máxima y sitios donde la amplitud siempre es mínima.

Observación del holograma

Alumbramos el holograma con ondas planas que vienen de la izquierda. La luz pasa por los "espacios" transparentes del holograma y cada "espacio" crea ondas semiesféricas que se propagan hacia la derecha. En la imagen a la derecha solo hemos dibujado la parte interesante de la cresta de las ondas. Se aclara que las ondas que salen de los "espacios" de la placa se adicionan para dar frentes de onda semiesféricos similares a los frentes producidos por la luz reflejada por el punto de la escena. Un observador situado a la derecha de la placa ve luz que parece salir de un punto situado en el sitio donde estaba el punto de la escena. Eso es debido al hecho que el holograma deja pasar – o favorece – la luz que tiene la "buena" fase en el "buen" sitio.

Objeto en lugar de un punto único

En realidad, la luz reflejada por una pequeña parte de un objeto (el punto del ejemplo precedente) es débil y solo puede contribuir a que zonas del holograma sean un poco más oscuras o más claras. Eso no impide la formación de frentes de onda semiesféricos durante la lectura del holograma. El observador encontrará solamente, que el punto es poco brillante.

Un segundo punto luminoso añade, al grabado del holograma, sus propias zonas un poco más claras u oscuras. A la observación, el segundo juego de zonas claras y oscuras crea otro conjunto de frentes de onda que parece originarse de la posición donde se encontraba el segundo punto. Si el punto se encontraba más lejos, se le "verá" más lejos y viceversa. El holograma graba la información tridimensional de la posición de los puntos.

Un objeto grande no es otra cosa que un conjunto de puntos. Cada zona puntual del objeto crea zonas más o menos grises que se adicionan en la placa. Cada conjunto de zonas grises crea, a la observación, ondas semiesféricas que parecen salir del "buen" sitio del espacio: y así vemos una imagen (virtual) del objeto.

En la práctica, este tipo de holograma – fino y con alumbrado perpendicular – es poco utilizado, ya que las emulsiones sensibles son más espesas que la longitud de onda. Además los hologramas con alumbrado perpendicular dan también imágenes más reales (en el sentido óptico de la palabra) inoportunas en la observación.

lunes, 13 de abril de 2015

DÍA DEL MAESTRO

¿Qué se celebra?

El día del maestro es una festividad en la que se conmemora a las personas que hacen de la enseñanza su trabajo habitual, como maestros, catedráticos y profesores.

La fecha de esta celebración varía entre los diferentes países, si bien la UNESCO sugiere hacerlo el 5 de octubre, práctica que ha sido seguida por numerosas naciones. En 1943, la Primera Conferencia de Ministros y Directores de Educación de las Repúblicas Americanas, celebrada en Panamá, propuso también una fecha unificada para todo el continente; eligiéndose el 11 de septiembre, aniversario del fallecimiento del estadista y educador argentino Domingo Faustino Sarmiento.Dicha fecha ha continuado conmemorándose en la Argentina, pero se ha abandonado en el resto del continente.

La fecha de esta celebración varía entre los diferentes países, si bien la UNESCO sugiere hacerlo el 5 de octubre, práctica que ha sido seguida por numerosas naciones. En 1943, la Primera Conferencia de Ministros y Directores de Educación de las Repúblicas Americanas, celebrada en Panamá, propuso también una fecha unificada para todo el continente; eligiéndose el 11 de septiembre, aniversario del fallecimiento del estadista y educador argentino Domingo Faustino Sarmiento.Dicha fecha ha continuado conmemorándose en la Argentina, pero se ha abandonado en el resto del continente.

En nuestro país

El Día del Maestro Ecuatoriano se celebra todos los años el 13 de Abril, es una fecha especial en la que se rinde homenaje a todas las personas que realizan este oficio de ser educadores, enseñando a muchas personas desde temprana edad con mucho esfuerzo para que de esa educación, salgan personas de bien.

El Día del Maestro Ecuatoriano se celebra todos los años el 13 de Abril, es una fecha especial en la que se rinde homenaje a todas las personas que realizan este oficio de ser educadores, enseñando a muchas personas desde temprana edad con mucho esfuerzo para que de esa educación, salgan personas de bien. Esta fecha conmemorativa se fija en el año 1920, bajo el gobierno de Alfredo Baquerizo Moreno, y se instituyó en honor a Juen Montalvo Fiallos, quien fue maestro y novelista ecuatoriano, nacido el 13 de abril de 1832, en la ciudad de Ambato.

A continuación te daremos algunos consejos de como festejar y rendir homenaje a esos queridos maestros.

Lo primero que puedes hacer para esa persona que lleva esta profesión en caso de que vivas con ella, puedes realizar un rico desayuno americano para cuando se levante tenga todo pronto para comenzar este día deleitando ricas comidas.

Si eres su esposo y tienen hijos chicos, les podrás proponer realizar un lindo regalo a mamá, como por ejemplo una manualidad, algo hecho por ustedes. Será un regalo que seguro apreciará mucho.

Para terminar este día, reunir a toda la familia en una cena será el toque final para que este día sea especial, te daremos algunos consejos de que podrás cocinar.

Lo primero que puedes hacer para esa persona que lleva esta profesión en caso de que vivas con ella, puedes realizar un rico desayuno americano para cuando se levante tenga todo pronto para comenzar este día deleitando ricas comidas.

Si eres su esposo y tienen hijos chicos, les podrás proponer realizar un lindo regalo a mamá, como por ejemplo una manualidad, algo hecho por ustedes. Será un regalo que seguro apreciará mucho.

Para terminar este día, reunir a toda la familia en una cena será el toque final para que este día sea especial, te daremos algunos consejos de que podrás cocinar.

domingo, 12 de abril de 2015

REDES SOCIALES

Una red social es una estructura social compuesta por un conjunto de actores (tales como individuos u organizaciones) que están relacionados de acuerdo a algún criterio (relación profesional, amistad, parentesco, etc.). Normalmente se representan simbolizando los actores como nodos y las relaciones como líneas que los unen. El tipo de conexión representable en una red social es una relación diádica o lazo interpersonal.

Las investigaciones han mostrado que las redes sociales constituyen representaciones útiles en muchos niveles, desde las relaciones de parentesco hasta las relaciones de organizaciones a nivel estatal (se habla en este caso de redes políticas), desempeñando un papel crítico en la determinación de la agenda política y el grado en el cual los individuos o las organizaciones alcanzan sus objetivos o reciben influencias. La red social también puede ser utilizada para medir el capital social (es decir, el valor que un individuo obtiene de los recursos accesibles a través de su red social).

El análisis de redes sociales estudia esta estructura social aplicando la teoría de grafos e identificando las entidades como "nodos" o "vértices" y las relaciones como "enlaces" o "aristas". La estructura del grafo resultante es a menudo una red compleja. Como se ha dicho, en su forma más simple una red social es un mapa de todos los lazos relevantes entre todos los nodos estudiados. Se habla en este caso de redes "socio céntricas" o "completas". Otra opción es identificar la red que envuelve a una persona (en los diferentes contextos sociales en los que interactúa); en este caso se habla de "red personal".

Las plataformas en Internet que facilitan la comunicación entre personas de una misma estructura social se denominan servicios de red social.

Redes sociales en Internet

Estas redes sociales se basan en la teoría de los seis grados, Seis grados de separación es la teoría de que cualquiera en la Tierra puede estar conectado a cualquier otra persona en el planeta a través de una cadena de conocidos que no tiene más de seis intermediarios. La teoría fue inicialmente propuesta en 1929 por el escritor húngaro Frigyes Karinthy en una corta historia llamada Chains. El concepto está basado en la idea que el número de conocidos crece exponencialmente con el número de enlaces en la cadena, y sólo un pequeño número de enlaces son necesarios para que el conjunto de conocidos se convierta en la población humana entera.

El término red social es acuñado principalmente a los antropólogos ingleses John Barnes y Elizabeth Bott, ya que, para ellos resultaba imprescindible cosiderar lazos externos a los famliares, residenciales o de pertenencia a algún grupo social.

Los fines que han motivado la creación de las llamadas redes sociales son varios, principalmente, es el diseñar un lugar de interacción virtual, en el que millones de personas alrededor del mundo se concentran con diversos intereses en común.

Recogida también en el libro "Six Degrees: The Science of a Connected Age” del sociólogo Duncan Watts, y que asegura que es posible acceder a cualquier persona del planeta en tan solo seis “saltos”.

Según esta Teoría, cada persona conoce de media, entre amigos, familiares y compañeros de trabajo o escuela, a unas 100 personas. Si cada uno de esos amigos o conocidos cercanos se relaciona con otras 100 personas, cualquier individuo puede pasar un recado a 10.000 personas más tan solo pidiendo a un amigo que pase el mensaje a sus amigos.

Estos 10.000 individuos serían contactos de segundo nivel, que un individuo no conoce pero que puede conocer fácilmente pidiendo a sus amigos y familiares que se los presenten, y a los que se suele recurrir para ocupar un puesto de trabajo o realizar una compra. Cuando preguntamos a alguien, por ejemplo, si conoce una secretaria interesada en trabajar estamos tirando de estas redes sociales informales que hacen funcionar nuestra sociedad. Este argumento supone que los 100 amigos de cada persona no son amigos comunes. En la práctica, esto significa que el número de contactos de segundo nivel será sustancialmente menor a 10.000 debido a que es muy usual tener amigos comunes en las redes sociales.

Si esos 10.000 conocen a otros 100, la red ya se ampliaría a 1.000.000 de personas conectadas en un tercer nivel, a 100.000.000 en un cuarto nivel, a 10.000.000.000 en un quinto nivel y a 1.000.000.000.000 en un sexto nivel. En seis pasos, y con las tecnologías disponibles, se podría enviar un mensaje a cualquier lugar individuo del planeta.

Evidentemente cuanto más pasos haya que dar, más lejana será la conexión entre dos individuos y más difícil la comunicación. Internet, sin embargo, ha eliminado algunas de esas barreras creando verdaderas redes sociales mundiales, especialmente en segmento concreto de profesionales, artistas, etc.

En la década de los 50, Ithiel de Sola Pool (MIT) y Manfred Kochen (IBM) se propusieron demostrar la teoría matemáticamente. Aunque eran capaces de enunciar la cuestión "dado un conjunto de N personas, ¿cual es la probabilidad de que cada miembro de estos N estén conectados con otro miembro vía k1, k2, k3,..., kn enlaces?", después de veinte años todavía eran incapaces de resolver el problema a su propia satisfacción.

En 1967, el psicólogo estadounidense Stanley Milgram ideó una nueva manera de probar la Teoría, que él llamó "el problema del pequeño mundo". El experimento del mundo pequeño de Milgram consistió en la selección al azar de varias personas del medio oeste estadounidense para que enviaran tarjetas postales a un extraño situado en Massachusetts, situado a varios miles de millas de distancia. Los remitentes conocían el nombre del destinatario, su ocupación y la localización aproximada. Se les indicó que enviaran el paquete a una persona que ellos conocieran directamente y que pensaran que fuera la que más probabilidades tendría, de todos sus amigos, de conocer directamente al destinatario. Esta persona tendría que hacer lo mismo y así sucesivamente hasta que el paquete fuera entregado personalmente a su destinatario final.

Aunque los participantes esperaban que la cadena incluyera al menos cientos de intermediarios, la entrega de cada paquete solamente llevó, como promedio, entre cinco y siete intermediarios. Los descubrimientos de Milgram fueron publicados en "Psychology Today" e inspiraron la frase seis grados de separación.

En The social software weblog han agrupado 120 sitios web en 10 categorías y QuickBase también ha elaborado un completo cuadro sobre redes sociales en Internet.

El origen de las redes sociales se remonta, al menos, a 1995, cuando Randy Conrads crea el sitio web classmates.com. Con esta red social se pretende que la gente pueda recuperar o mantener el contacto con antiguos compañeros del colegio, instituto, universidad, etcétera.

Alrededor del cambio de siglo surge en internet el concepto Web 2.0, cuyas páginas web diseñadas para fomentar la comunicación y adaptarse al usuario apoyan la popularización de estos servicios.

En 2002 comienzan a aparecer sitios web promocionando las redes de círculos de amigos en línea cuando el término se empleaba para describir las relaciones en las comunidades virtuales, y se hizo popular en 2003 con la llegada de sitios tales como MySpace o Xing. Hay más de 200 sitios de redes sociales, aunque Friendster ha sido uno de los que mejor ha sabido emplear la técnica del círculo de amigos. La popularidad de estos sitios creció rápidamente y grandes compañías han entrado en el espacio de las redes sociales en Internet. Por ejemplo, Google lanzó Orkut el 22 de enero de 2004. Otros buscadores como KaZaZZ! y Yahoo crearon redes sociales en 2005.

En estas comunidades, un número inicial de participantes envían mensajes a miembros de su propia red social invitándoles a unirse al sitio. Los nuevos participantes repiten el proceso, creciendo el número total de miembros y los enlaces de la red. Los sitios ofrecen características como actualización automática de la libreta de direcciones, perfiles visibles, la capacidad de crear nuevos enlaces mediante servicios de presentación y otras maneras de conexión social en línea. Las redes sociales también pueden crearse en torno a las relaciones comerciales.

Las herramientas informáticas para potenciar la eficacia de las redes sociales online («software social»), operan en tres ámbitos, «las 3 Cs», de forma cruzada:

Comunicación (nos ayudan a poner en común conocimientos).

Comunidad (nos ayudan a encontrar e integrar comunidades).

Cooperación (nos ayudan a hacer cosas juntos).

El establecimiento combinado de contactos (blended networking) es una aproximación a la red social que combina elementos en línea y del mundo real para crear una mezcla. Una red social de personas es combinada si se establece mediante eventos cara a cara y una comunidad en línea. Los dos elementos de la mezcla se complementan el uno al otro. Vea tambiéncomputación social.

http://es.wikipedia.org/wiki/Red_social

lunes, 6 de abril de 2015

domingo, 5 de abril de 2015

domingo, 22 de marzo de 2015

Reloj Inteligente

Un reloj inteligente o pulsera inteligente, es un reloj de pulsera revolucionario, que ofrece funciones ampliamente mejoradas a las de un reloj de pulsera habitual, a menudo estas funciones son comparables con las de un PDA. Los primeros modelos de relojes inteligentes eran capaces de realizar funciones básicas como cálculos, traducciones o ejecutar mini juegos, pero los actuales relojes inteligentes ya son capaces de desempeñar funciones mejoradas, como las de un teléfono inteligente o incluso un ordenador portátil. Muchos relojes inteligentes pueden ejecutar aplicaciones móviles, algunos otros se ejecutan en un sistema operativo de teléfonos inteligentes para controlarlos, y unos pocos ya tienen las capacidades técnicas de un teléfono móvil.

Cualquier dispositivo tiene un procesador de datos, memoria, entrada y salida. Se puede recoger información de los sensores internos o externos. Se puede controlar, o recuperar datos de otros instrumentos o equipos. Puede apoyar tecnologías inalámbricas como Bluetooth, Wi-Fi y GPS. Sin embargo, es posible que un reloj inteligente sólo sirva como interfaz para un sistema remoto, como en el caso de los relojes que utilizan la tecnología celular o Wi-Fi.

domingo, 15 de marzo de 2015

LA WEB

En informática, la World Wide Web (WWW) o Red informática mundialcomúnmente conocida como la Web, es un sistema de distribución de documentos dehipertexto o hipermedios interconectados y accesibles vía Internet. Con un navegador web, un usuario visualiza sitios web compuestos de páginas web que pueden contener texto, imágenes, vídeos u otros contenidos multimedia, y navega a través de esas páginas usando hiperenlaces.

La Web se desarrolló entre marzo de 1989 y diciembre de 1990 por el inglés Tim Berners-Lee con la ayuda del belga Robert Cailliau mientras trabajaban en elCERN en Ginebra, Suiza, y publicado en 1992. Desde entonces, Berners-Lee ha jugado un papel activo guiando el desarrollo de estándares Web (como loslenguajes de marcado con los que se crean las páginas web), y en los últimos años ha abogado por su visión de una Web semántica. Utilizando los conceptos de sus anteriores sistemas de hipertexto como ENQUIRE, el ingeniero británico Tim Berners-Lee, un científico de la computación y en ese tiempo de los empleados del CERN, ahora director del World Wide Web Consortium (W3C), escribió una propuesta en marzo de 1989 con lo que se convertiría en la World Wide Web. la propuesta de 1989 fue destinada a un sistema de comunicación CERN pero Berners-Lee finalmente se dio cuenta que el concepto podría aplicarse en todo el mundo. En la CERN, la organización europea de investigación cerca de Ginebra, en la frontera entre Francia y Suiza,Berners-Lee y el científico de la computación belga Robert Cailliau propusieron en 1990 utilizar el hipertexto "para vincular y acceder a información de diversos tipos como una red de nodos en los que el usuario puede navegar a voluntad", y Berners-Lee terminó el primer sitio web en diciembre de ese año.Berners-Lee publicó el proyecto en el grupo de noticias alt.hypertext el 7 de agosto de 1991.

Funcionamiento de la Web

El primer paso consiste en traducir la parte nombre del servidor de la URL en una dirección IP usando la base de datos distribuida de Internet conocida como DNS. Esta dirección IP es necesaria para contactar con el servidor web y poder enviarle paquetes de datos.

El siguiente paso es enviar una petición HTTP al servidor web solicitando el recurso. En el caso de una página web típica, primero se solicita el texto HTML y luego es inmediatamenteanalizado por el navegador, el cual, después, hace peticiones adicionales para los gráficos y otros ficheros que formen parte de la página. Las estadísticas de popularidad de un sitio web normalmente están basadas en el número de páginas vistas o las peticiones de servidor asociadas, o peticiones de fichero, que tienen lugar.

Al recibir los ficheros solicitados desde el servidor web, el navegador renderiza la página tal y como se describe en el código HTML, el CSS y otros lenguajes web. Al final se incorporan las imágenes y otros recursos para producir la página que ve el usuario en su pantalla.

Estándares web

Destacamos los siguientes estándares:

el Identificador de Recurso Uniforme (URI), que es un sistema universal para referenciar recursos en la Web, como páginas web,

el Protocolo de Transferencia de Hipertexto (HTTP), que especifica cómo se comunican el navegador y el servidor entre ellos,

el Lenguaje de Marcado de Hipertexto (HTML), usado para definir la estructura y contenido de documentos de hipertexto,

el Lenguaje de Marcado Extensible (XML), usado para describir la estructura de los documentos de texto.

Berners Lee dirige desde 2007 el World Wide Web Consortium (W3C), el cual desarrolla y mantiene esos y otros estándares que permiten a los ordenadores de la Web almacenar y comunicar efectivamente diferentes formas de información.

http://es.wikipedia.org/wiki/World_Wide_Web

domingo, 8 de marzo de 2015

VEHÍCULOS HÍBRIDOS

El término se refiere más comúnmente alvehículo híbrido eléctrico, que combina unmotor de combustión interna y uno o varios motores eléctricos. Otros tipos de sistemas de propulsión híbridos incorporan una celda de combustible, supercondensador, motor de aire comprimido o batería inercial, en combinación con un motor de combustión o eléctrico.

Según el sistema utilizado, un vehículo híbrido puede tener una mayor eficiencia energética. Esto puede deberse al uso de un motor más pequeño, y la utilización de sistemas de recuperación de energía (tales como frenos regenerativos). Como consecuencia del menor consumo energético, se obtienen beneficios económicos y ambientales. Sin embargo, algunas tecnologías híbridas tienen perjuicios ambientales, por ejemplo la producción y reciclado de baterías.

Tipos de vehículo

El Ciclomotor, la bicicleta motorizada, incluso el patinete eléctrico son una forma sencilla de un híbrido , como la fuente de poder se entrega tanto a través de un Motor de combustión interna o Motor eléctrico y con los músculos del ciclista . Los primeros prototipos de motocicletas en el siglo XIX utilizan los mismos principios para alimentar el equipo .De dos ruedas y tipo ciclo

Vehículos pesados

Un Sistema de propulsión híbrido utiliza la Transmisión diésel-eléctrico o transmisión turbo eléctrica para locomotoras de potencia, autobuses, camiones de gran tonelaje, Máquina hidráulica y barcos. Típicamente alguna forma de motor térmico (normalmente diésel) acciona un generador eléctrico o bomba hidráulica que poderes uno o más motores eléctricos o hidráulicos. Hay ventajas en la distribución de la energía a través de cables o tuberías en lugar de elementos mecánicos. Hay potencia perdida en la doble conversión de combustible diésel, por lo general la electricidad para alimentar un motor eléctrico o hidráulico. Con los vehículos grandes las ventajas a menudo superan los inconvenientes, especialmente ya que las pérdidas de conversión normalmente disminuyen con el tamaño. Con la excepción no nuclear el Submarino, actualmente no existe o relativamente poca capacidad de almacenamiento de energía secundaria en la mayoría de los vehículos pesados, por ejemplo, baterías auxiliares y acumulador hidráulico —aunque esto está cambiando. Los submarinos son una de las aplicaciones más antiguas generalizadas de la tecnología híbrida, que se ejecuta en los motores diésel, mientras que a la superficie y el cambio a energía de la batería cuando está sumergido. Las transmisiones paralelas híbridas y las series-híbrido se utilizaron en la Segunda Guerra Mundial.

Transporte por ferrocarril

Europa

La nueva "Autorail à grande capacité" (AGC o autovía de alta capacidad) construida por la empresa canadiense Bombardier Transportation para dar servicio en Francia. Ésta tiene el modo dual (motores diesel y eléctricos) y capacidades de doble voltaje (1.500 y 25.000 V) lo que le permite ser utilizado con bastantes sistemas diferentes ferroviarios. La locomotora ha estado en pruebas en Róterdam, los Países Bajos como Railfeeding, en Genesse y en la empresa Wyoming.China

El primer prototipo de locomotora híbrida evaluada fue diseñado y contratado por el centro de investigación ferroviaria MATRAI en 1999 y la muestra estuvo lista en el 2000. La locomotora G12 se convirtió en híbrido utilizando un generador diésel 200KW, baterías y también fue equipada con 4 motores de tracción de CA (de un total de 4).

Japón

El primer prototipo operativo de una máquina de tren híbrido con el almacenamiento de energía significativo y con la capacidad de regeneración de energía fue introducida en Japón como el Kiha E200. Utiliza baterías como la Batería de iones de litio puesta en el techo para almacenar energía.América del Norte

En Estados Unidos, General Electric introdució un prototipo de locomotora con su tecnología " Ecomagination " en 2007. Almacenan energía en un amplio conjunto de Batería de sal fundida (Na-NiCl2) las baterías capturan y almacenan la energía que normalmente se disipa con el Freno dinámico o descender una pendiente . Ellos esperan que al menos una reducción del 10 % en el uso de combustible con este sistema ayude y ahora están gastando más de $ 2 billones al año en una investigación híbrida.Las variantes de la típica locomotora diésel incluye a Locomotora de maniobras como Green Goat (GG) y Green Kid (GK) construidas por la empresa canadiense Railpower Technologies. Utilizan un sistema grande de la larga vida de servicio pesado (~ 10 años) recargable [ [ batería de plomo | plomo ] ] (PBA) baterías y 1000-2000 HP motores eléctricos como las fuentes motrices primarias y un nuevo generador diesel de combustión limpia (~ 160 Hp) para la recarga de las baterías que se utilizan es sólo cuando sea necesario. No está claro si el Freno dinámico ( regenerativo ) de potencia es recapturado para su utilización; pero en principio, debería ser fácilmente utilizado .

Dado que estos motores típicos tienen peso extra con fines de tracción de todos modos el peso de la batería es una desventaja despreciable . Además, el generador diésel y el paquete de baterías se construyen normalmente en un " " marco existente "se retiró " el patio de la locomotora de significativos ahorros de costos adicionales. El engranaje de motores existentes y en funcionamiento son todos reconstruido y reutilizado. Ahorro de combustible diésel de 40 a 60 % y hasta un 80 % de reducción de la contaminación son reclamados respecto a la de un motor de "típico" mayor conmutación / patio. Las mismas ventajas que los coches híbridos existentes tienen para su uso con arranques y paradas frecuentes y los períodos de inactividad se aplican a su uso típico patio de maniobras. Locomotoras "Green Goat" han sido adquiridas por Canadian Pacific Railway, BNSF Railway, Kansas City Southern Railway, y Union Pacific Railroad entre otras.

Cranes

Ingenieros de Railpower Technologies que trabajan con TSI Terminal Systems están probando una unidad de alimentación eléctrica diésel híbrido con almacenamiento en baterías para su uso en grúas de Rubber Tyred Gantry (RTG). Las grúas RTG se utilizan normalmente para la carga y descarga de contenedores de transporte en trenes o camiones en los puertos y patios de almacenamiento de contenedores.

El transporte por carretera, los vehículos comerciales

Los primeros sistemas híbridos están siendo investigados por los camiones y otros vehículos pesados de carretera con algunos camiones operativos y autobuses que comienzan a entrar en uso.

Vehículos militares todo terreno

Desde 1985, los militares de Estados Unidos ha estado probando híbridos en serieHumvees y los ha hallado para ofrecer una aceleración más rápida, con una Tecnología furtiva un modo de cautela con baja firma térmica, funcionamiento casi silencioso y una mayor economía de combustible.

Barcos

Barcos con combinaciones de un montado mástil, Vela (náutica) o Máquina de vapor eran una forma cercana a un vehículo híbrido. Otro ejemplo es el Submarino de Transmisión diesel-eléctrica. Éste funciona con baterías durante la inmersión y las baterías se pueden volver a cargar por el Motor diésel solo cuando la embarcación está en la superficie.

El más nuevo híbrido incluye grandes esquemas de buques de propulsión "potencia cometa" manufacturado por empresas como SkySails. Cometas de remolque pueden volar a varias alturas a veces superiores a los mástiles de los barcos más altos, la captura de los vientos fuertes y más estables.

Aeronaves

La célula de combustible Boeing Avión Demostrador tiene un sistema híbrido con la batería de iones de litio de celda de combustible y Proton Exchange Membrane (PEM) para alimentar un motor eléctrico, que está acoplado a una hélice convencional.

http://es.wikipedia.org/wiki/Veh%C3%ADculo_h%C3%ADbrido

Suscribirse a:

Entradas (Atom)